26/11/2024

La revista Gaming Intelligence ha publicado recientemente un interesante artículo sobre cómo el Reglamento Europeo de la IA cambia las reglas del juego, escrito por nuestros expertos Luis Latasa, socio del departamento de Derecho Digital y Propiedad Intelectual en EJASO y Rodrigo López, Asociado Principal en el departamento de Derecho Digital y Propiedad Intelectual en EJASO.

El pasado 1 de agosto entró en vigor el Reglamento Europeo de Inteligencia Artificial (IA). Esta norma prevé fomentar la implantación de la IA en Europa de forma responsable. Desde LOYRA-EJASO nos han explicado en profundidad en qué consiste este Reglamento, qué permite y qué sanciona y cómo va a sentar las nuevas reglas del juego para los innovadores de toda Europa, de los que no están exentas las empresas de la industria del iGaming y el gambling.

La industria del iGaming está inmersa en una nueva era tecnológica, en la que el uso de sistemas de IA favorece la aportación de datos masivos, por ejemplo, en las probabilidades de las apuestas deportivas. O en el potencial desarrollo de juegos de próxima generación. O en la integración de plataformas o sistemas.

Luis María Latasa y Rodrigo López Crespo, Socio y Asociado Principal respectivamente del despacho, explican que actualmente nos encontramos en un segundo periodo de la ‘oleada de la IA’. Si la primera -entre los años 80 y 90-, se caracterizó por el razonamiento simbólico, esta se define por el llamado “machine learning”. Las máquinas están aprendiendo a brindar los resultados que se les piden. Posteriormente se espera que una tercera era permita funcionar a la IA sin supervisión humana.

En este contexto, la Comisión Europea (CE) tomó la decisión de regular el mercado de forma armónica en todo su territorio con un enfoque basado en la protección de los derechos fundamentales. Se pretendía así proteger a los ciudadanos frente a los “efectos perjudiciales” de la IA, además de favorecer la innovación e impedir las restricciones no autorizadas.

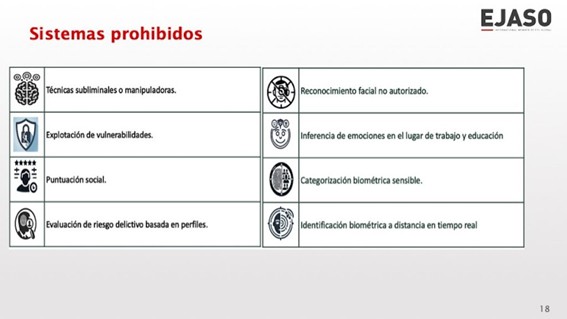

Para ello, explica Latasa, la CE se aproximó a la IA basándose en sus potenciales riesgos. Y desarolló una “norma abierta, de alcance limitado”, que obliga a los proveedores – fabricantes, importadores, distribuidores y responsables del despliegue a cumplir ciertos requisitos. El Reglamento establece varios niveles de riesgo, teniendo en cuenta los efectos que puede tener la IA respecto de los derechos fundamentales, la salud o la seguridad, y prohíbe determinados sistemas por su peligrosidad, como las técnicas subliminales, entre otros.

El Reglamento considera cuatro niveles de riesgo:

Según los abogados del despacho, en el caso de los sistemas de IA de alto riesgo, los importadores de sistemas de IA en Europa deben asegurarse de que el sistema cumple con el Reglamento; con la documentación y el almacenamiento adecuados; con el marcado y todos los requisitos de la CE, además de cooperar con las autoridades. En el caso de los distribuidores, además, se pide no comercializar el sistema si no se considera conforme con la normativa.

Los proveedores, por su parte, deberán velar por el cumplimiento de este Reglamento tanto a nivel de diseño del Sistema, como en el cumplimiento de otras obligaciones tanto generales como específicas del sistema (declaración de conformidad, etc.); contar con un sistema de conservación de documentación y archivos generados automáticamente, y estar registrados en la base de datos de la UE, entre otros requisitos.

En cuanto a las empresas que usan la IA bajo su propia autoridad y que dentro de la norma son denominados “responsables de despliegue”, tendrán que tomar medidas técnicas y organizativas para que se utilice conforme a las instrucciones de los proveedores, conservar registros etc. Además, deben tener una supervisión humana por personas competente y capacitadas, ofrecer datos de entrada pertinentes y suficientes, e informar a las autoridades si observan riesgos, así como realizar evaluaciones de impacto en determinados casos.

Si se usan sistemas de riesgo limitado, como los destinados a interactuar con personas, el proveedor debe informar de que se interactúa con IA. Si se ofrece contenido sintético, sus responsables velarán por que los resultados estén marcados claramente como contenido generado por IA y legible por máquinas. En el caso de sistemas de reconocimiento emocional o biométrico, es vital que quienes despliegan la IA informen y cumplan con las regulaciones de protección de datos. En los casos de ultra suplantación, las empresas que los desplieguen deben marcar claramente que los resultados se han generado o manipulado de forma artificial. En el caso de obras creativas, tendrán que informar del contenido sintético.

Tras estos primeros pasos, se espera que la norma se vaya enriqueciendo con más directrices y actos delegados. Además, su aplicación será progresiva, como muestra la infografía.

“Aunque el propósito de la CE sea loable y comprensible, sobre todo para evitar la fragmentación del mercado, percibimos que este Reglamento está generando más temor, que favoreciendo el desarrollo de sistemas de IA”, afirman Latasa y López Crespo. “Lejos de favorecer la innovación, podría generar el riesgo de que Europa se quede rezagada si no crea un marco normativo adecuado”.

Otro asunto son las elevadas sanciones que propone el reglamento, que oscilan desde el 3% del volumen de negocios anual de una empresa, o 15 millones de euros, hasta los 35 millones o el 7% del volumen de negocios, para los casos más graves.

Los expertos estiman comprensible que “Europa haya querido dar un paso adelante y armonizar normativas” para evitar la fragmentación normativa dentro de la propia Europa.

El asunto es especialmente llamativo si enfocamos en el sector del juego, con numerosas fragmentaciones normativas en función de cada país, e incluso de cada comunidad autónoma, si hablamos de España.

“Con el juego venimos de regulaciones fragmentadas, donde se ha entendido siempre que era un tema muy nacional, de salud pública… Al final hay que atender a la normativa del país al que te diriges. Probablemente, para evitar eso han querido unificar y reformar, pero la percepción de nuestros clientes es ese efecto huida que estábamos comentando”, aseguran.

El otro efecto ‘perverso’ de esta norma es que las empresas usuarias europeas puedan “tener una desventaja competitiva” respecto a las de otras regiones si “nuestros trabajadores no pueden usar determinados modelos, porque los fabricantes no van a querer comercializarlos en Europa”. “En la medida en que impacta en la eficiencia operativa de las empresas, es una desventaja competitiva y esto es aplicable a todos los sectores”, advierten.

La inteligencia artificial ha venido para quedarse y solo el tiempo dirá cómo impactará este restrictivo Reglamento Europeo en los distintos sectores económicos, incluido el juego.